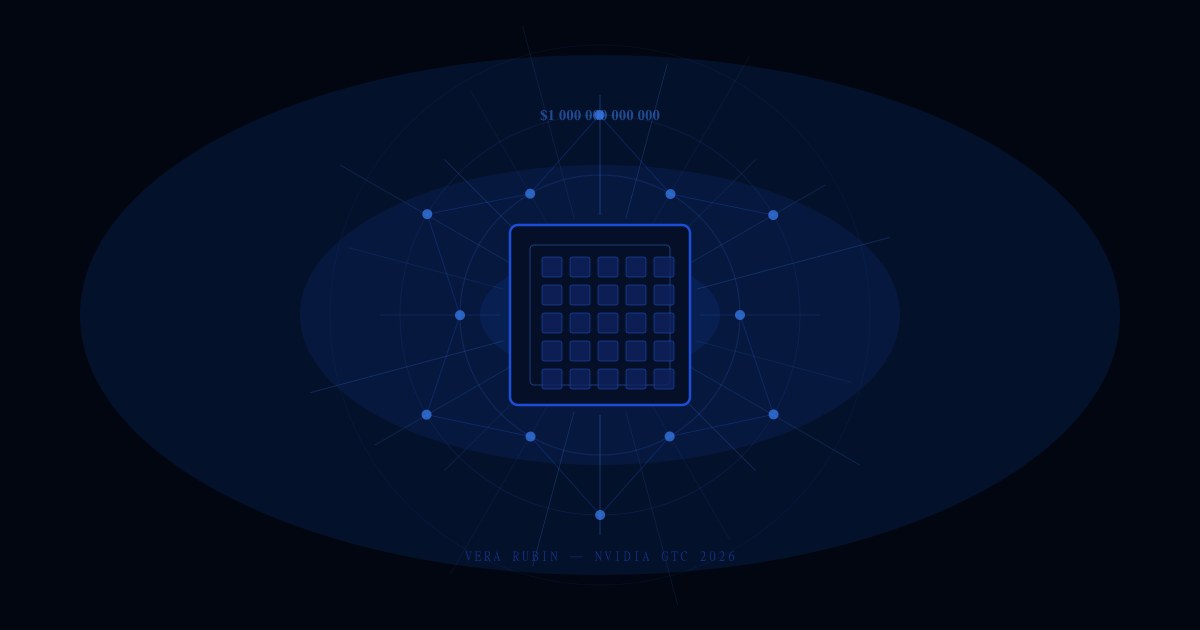

Jensen Huang onthult Vera Rubin op GTC 2026: Nvidia ziet 1 biljoen dollar aan AI-chiporders tot en met 2027

Op de jaarlijkse GTC-conferentie presenteerde Nvidia-CEO Jensen Huang het Vera Rubin-platform: een systeem van zeven chips en vijf rack-types dat tienmaal meer rekenkracht per watt levert dan de huidige Blackwell-architectuur. Huang meldde dat Nvidia al voor 1 biljoen dollar aan orders heeft voor Blackwell en Vera Rubin samen, het dubbele van de prognose een jaar geleden.

Vera Rubin: zeven chips als een supercomputer

Nvidia CEO Jensen Huang presenteerde op 16 maart tijdens de GTC 2026-conferentie in San Jose het Vera Rubin-platform, het volgende grote hoofdstuk in de AI-chipstrategie van het bedrijf. Vera Rubin is geen chip in de traditionele zin: het is een systeem van zeven nieuwe chips en vijf rack-schaal-systemen die samen functioneren als een gedistribueerde supercomputer voor agentic AI. De naam verwijst naar de Amerikaanse astronome Vera Rubin, die begin jaren tachtig het eerste overtuigende bewijs verzamelde voor het bestaan van donkere materie. Het systeem telt 1,3 miljoen componenten en levert tien keer meer rekenprestatie per watt dan de vorige generatie, de Grace Blackwell-architectuur die eind 2024 werd uitgebracht. Vera Rubin wordt later in 2026 geleverd aan de eerste klanten.

Een biljoen dollar aan orders: het dubbele van vorig jaar

De meest spraakmakende uitspraak van Huang was zijn aankondiging over de orderportefeuille. "Ik zie nu voor Blackwell en Vera Rubin gecombineerd een biljoen dollar aan bestellingen door 2027," zei Huang tijdens zijn keynote. Ter vergelijking: een jaar geleden lag de prognose voor een gecombineerde omzetkans op 500 miljard dollar. Die verdubbeling weerspiegelt de explosieve vraag naar AI-infrastructuur vanuit hyperscalers als Amazon, Microsoft, Google en Oracle, maar ook vanuit nationale AI-programmas in de VS, de EU en Azie. Amazon Web Services heeft al toegezegd meer dan een miljoen Nvidia GPU's in te zetten naast de nieuwe Groq LPU-chips. Microsoft Azure, Google Cloud en Oracle Cloud zijn eveneens verbonden aan het Vera Rubin-ecosysteem.

Vera Rubin GPU: geheugen direct op de chip gestapeld

Technisch gezien introduceert de Vera Rubin GPU een nieuw geheugendesign: de zogenoemde CG-HBM-architectuur, waarbij het HBM-geheugen (High Bandwidth Memory) direct op de chip wordt gestapeld in plaats van ernaast te worden geplaatst. Dit verlaagt de latentie en verhoogt de geheugenbandbreedte aanzienlijk, wat met name relevant is voor het draaien van de steeds grotere taalmodellen die de AI-industrie vereist. De geheugenbandbreedte is drie tot vier keer hoger dan bij Blackwell, terwijl het energieverbruik per berekening verder daalt. Nvidia koppelt de Rubin GPU aan de zelfontworpen Vera CPU, waardoor voor het eerst een volledig Nvidia-ontworpen processor-geheugen-architectuur beschikbaar is zonder afhankelijkheid van externe leveranciers als AMD of Arm.

Groq-overname voor 20 miljard dollar levert eerste chip op

Naast Vera Rubin kondigde Huang de Nvidia Groq 3 Language Processing Unit aan, de eerste chip die voortkomt uit de overname van het grootste deel van het chipstartup Groq voor 20 miljard dollar in december 2025. De Groq LPU is gespecialiseerd in inferentie: het snel uitvoeren van al getrainde AI-modellen, in tegenstelling tot training waarbij grote GPU-clusters nodig zijn. De LPU is ontworpen om grote taalmodellen met minimale vertraging te draaien, wat essentieel is voor toepassingen zoals real-time vertaling, conversationele AI en medische diagnostiek. De chip wordt verwacht in het derde kwartaal van 2026 en is bedoeld als aanvulling op de Rubin GPU's in zogenoemde AI-fabrieken.

Dynamo 1.0: het besturingssysteem van de AI-fabriek

Een minder zichtbare maar technisch belangrijke aankondiging was Dynamo 1.0, het softwareplatform dat Nvidia positioneert als het "besturingssysteem van de AI-fabriek". Dynamo optimaliseert de werkverdeling tussen honderden of duizenden GPU's in een datacenter en verhoogt de inferentieprestaties van Blackwell GPU's met een factor zeven. Daarmee lost het een praktisch knelpunt op: AI-modellen draaien in productie vaak inefficient omdat GPU-capaciteit niet optimaal wordt verdeeld over gelijktijdige verzoeken. Dynamo is als open-source beschikbaar gesteld, een ongebruikelijke stap voor Nvidia die zijn software traditioneel gesloten houdt.

Van chipmaker naar AI-infrastructuurarchitect

Analisten wijzen erop dat Nvidia met GTC 2026 een strategische verschuiving heeft laten zien: het bedrijf presenteert zichzelf niet langer primair als leverancier van GPU's, maar als architect van de volledige AI-infrastructuurketen. Silicon, networking, software, agentic platforms en robotica worden steeds meer als een geintegreerd geheel aangeboden. Critici waarschuwen voor de risicos van deze marktdominantie: de AI-industrie is in toenemende mate afhankelijk van een enkel bedrijf voor de meest kritieke hardware. De EU voert op basis van de Digital Markets Act al gesprekken over de vraag of Nvidias positie in de markt voor AI-chips aanleiding geeft tot aanvullend toezicht.

Bronnen

Reacties

Nog geen reacties. Wees de eerste!

Laat een reactie achter

Reacties worden gemodereerd voor publicatie. Uw e-mailadres wordt niet gepubliceerd.